Gartner:人工智能将如何影响工作

- 电脑快讯

- 1年前

- 133

- 更新:2024-01-25 17:38:43

在2023年Gartner研讨会上,多位分析师提出了未来几年人工智能将如何发展的各种愿景。从考察人工智能对工作和工作未来的影响,到将人工智能视为队友,再到关于人工智能可能的未来及其对各种组织的影响的多种不同情景。

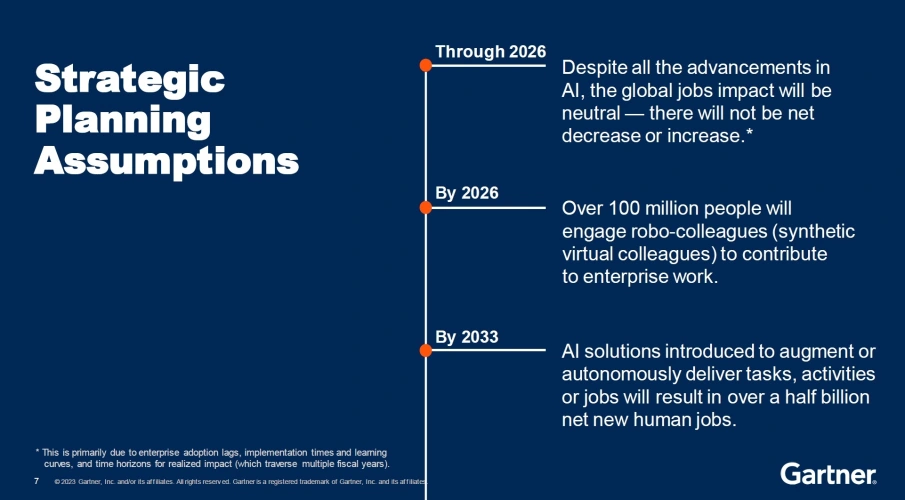

在整个会议上,有几个演讲提到了高德纳对人工智能对就业影响的总体预测。该公司预测,到2026年,人工智能对全球就业的影响将是中性的,但到那时,将有超过1亿人使用机器人同事(“合成虚拟同事”)为他们的工作做出贡献。高德纳预计,到2033年,人工智能解决方案将带来超过5亿个新的人类工作岗位。

也许吧。Difference SESSIONS试图展示这可能如何发生,处理人类与人工智能或机器人之间的关系,人工智能如何融入团队,它将如何影响工作的未来,并为人工智能的发展提供不同的场景。

人机关系

Gartner的Mary Mesaglio在她的开幕式主旨演讲中阐述了一个主要主题,她说,生成性人工智能时代将改变人机关系。

她说,为了正确处理机器和人类之间的关系,我们既需要机器专家,也需要人类专家。我们需要从关注社交媒体转向关注亲密关系和与机器的关系。我们将需要指导原则来解决无法预见的困境。

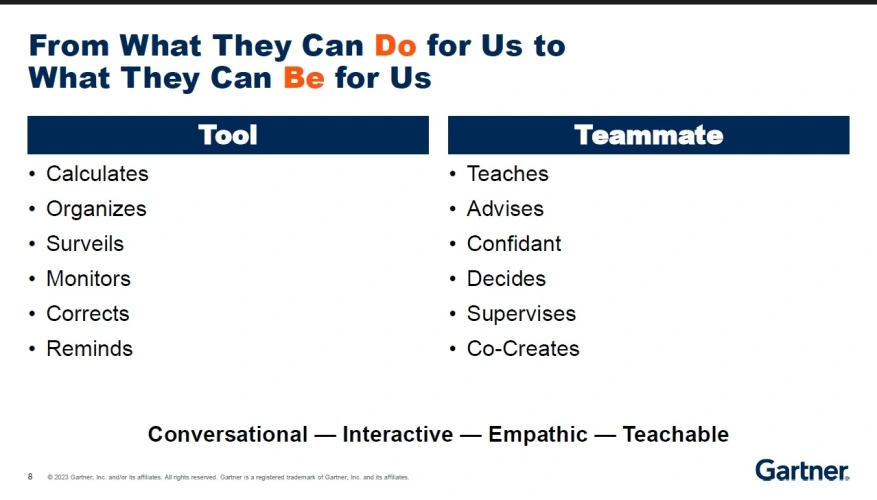

梅萨格里奥说,我们倾向于将机器视为工具,但有了产生式人工智能,我们还需要将它们视为队友,能够做像教学这样的事情,甚至为我们决定事情。大多数观众对让机器做财务审计之类的事情感到满意,但对让机器做性能评估等事情感到不舒服。

她说,我们将需要伦理学家、行为学家、人类学家和社会学家来帮助我们更好地了解我们对机器的反应。我们倾向于将机器拟人化,她提出了几个我们需要牢记的设计概念。

她指出,我们正在看到“数字去抑制”,人们在机器上的行为与在人身上的行为不同–这可能是不好的,就像社交媒体上最糟糕的事情一样–也可能是好的,比如机器充当治疗师,帮助那些本来不会寻求治疗的人。她还谈到了普遍的期望,如果一台机器可以做一些事情,我们希望所有的机器都能做到这一点。最后,她讨论了“算法厌恶”,即我们对机器有不同的标准,例如,如果一场车祸恰好是一辆自动驾驶汽车,我们会以不同的标准对待它。

梅萨格里奥谈到了一款日本聊天机器人,它成功地完成了说服人们不要自杀等事情。当它开始发表太多的提示性评论时,该公司缓和了语气,但面临着来自用户的大量投诉,他们说他们给它做了“脑叶切除”。

展望未来,我们将不得不考虑如何对待机器,以及我们需要什么样的法规和政策来控制它们,她说。“在人工智能的世界里,我们需要更好的人类。”

周二CIO午餐谈话

麻省理工学院媒体实验室的凯特·达林在一次午餐会上呼应了改变与机器的关系的主题,该午餐会的重点是人与机器人的互动。

人类总是倾向于将事物拟人化。她指出,人们是如何与毛绒动物联系在一起的,因为我们天生就会识别面孔。但我们也会对运动做出反应,她声称85%的Roomba所有者给那些机器人吸尘器起了名字。

她回到了开场白中提到的一个实验,在这个实验中,研究人员花了一个小时玩机器人玩具恐龙Pleo。在一组研究人员花了一些时间研究这个玩具并给它起了一个名字后,他们被递给了一把锤子和一把刀,并被告知要销毁它。都拒绝了。她在其他机器人身上看到了类似的情况,并说我们对栩栩如生的机器人做出反应。“人们对待这些东西的方式与其他设备不同,”她说。

达林讨论了人们对类人机器人的反应,讲述了一些与梅萨格里奥在演讲中相同的故事,包括谈论人们在医院和其他环境中对机器人的反应。

她认为,我们应该更认真地对待像Blake Lemoine这样的人–这位谷歌工程师曾表示,他认为谷歌的人工智能系统是“有感觉的”。重要的是,人们对待一些机器人就像它们是有知觉的一样。她指出,这种机器人已经成为动物疗法的替代品。

在未来,我们可以选择如何处理社交机器人,以及如何负责任和有效地将它们融入我们的生活。机器人和人工智能的真正潜力不是取代我们已经拥有的东西,而是创造新的东西。她最后说:“机器人不能决定未来。我们才能。”

AI加入团队

Gartner的Erick Brethenoux做了一场题为《AI加入团队》的演讲,介绍了不同种类的AI,并敦促观众在这项技术上承担更多风险。

他强调,生成性人工智能并不是人工智能的全部-人工智能是一套技术,生成性人工智能是对此的一种实践。人工智能也不是机器人技术;机器人技术是人工智能的一个用例,但世界上98%的机器人不使用人工智能。“人工智能不再是一个道具,它是一个演员,”他说。

他接着谈到了如何让大多数人,AI突然出现,因为他们的第一次体验是ChatGPT,对他们来说感觉就像是魔术。随之而来的是,人们的注意力从以数据为中心转向以决策为中心,人工智能采取了行动,成为了队友。

人工智能现在是我们组织中的一个永久固定装置,我们应该习惯这一点,布雷特努克斯说,并重申了“日常人工智能”和“改变游戏规则的人工智能”之间的区别。日常人工智能包括组织今天在已建立的边界内进行的项目,但略有增加。我们都已经进入了人工智能游戏,我们的手机和GPS系统上都有人工智能应用程序。这些都是“在边界之内”的事情,比如在生产力应用程序中。

这些占人工智能计划的80%,通常时间范围为几个月或一年。但这些应用程序不需要是平凡的,比如给生病孩子的父母写便条。

然后,还有“改变游戏规则的人工智能”,它们“挑战极限(占应用程序的17%),通常挑战期限约为18个月的跨功能应用程序,这些应用程序可能耗资数十万或数百万美元。例如,可以在围棋中击败人类的软件。”

最后,他说,有3%的应用程序正在打破界限,人工智能实现了某种形式的代理,通常时间框架为24个月或更长时间。这些都很贵,价格可能在几百万美元左右。他提到的例子包括生产化合物和药物,以及可以学习如何做到这一点的投资体系(存在过度自信的问题)。

Brethenoux说,你走得越远,潜在的回报就越大,但潜在的风险就越大,保持人工智能公平、可靠和可持续的必要性就越大。

但在每个层面上,失败都应该是一种选择,因为“无所作为的风险从未像现在这样高。”风险是任何IT优先事项的一部分,他说,“打破界限是最安全的竞争方式。”

他建议公司任命一名人工智能主管,以协调想法并促进人工智能领域的创新,包括在公司内设立人工智能素养计划。Brethenoux推动人工智能成为“增强智能”。

产生式人工智能将如何影响未来的工作?

在一场关于产生式人工智能将如何影响未来工作的会议上,Gartner的海伦·普瓦特温指出,产生式人工智能只是人工智能的一个子集,她采访的所有公司都在考虑更广泛的人工智能视角。她分享了一项调查的结果,该调查显示,认为人工智能可以取代他们的工作的员工明年打算离开这些工作的可能性要高出27%。在一个平均有10,000名员工的组织中,留任意向的减少每年要花费5300万美元的总成本和生产力损失。雇主可以通过揭开关于人工智能和工作的一些想法的神秘面纱来改变这种情况。通过培训和提高员工的技能,留任意向可以显著提高。

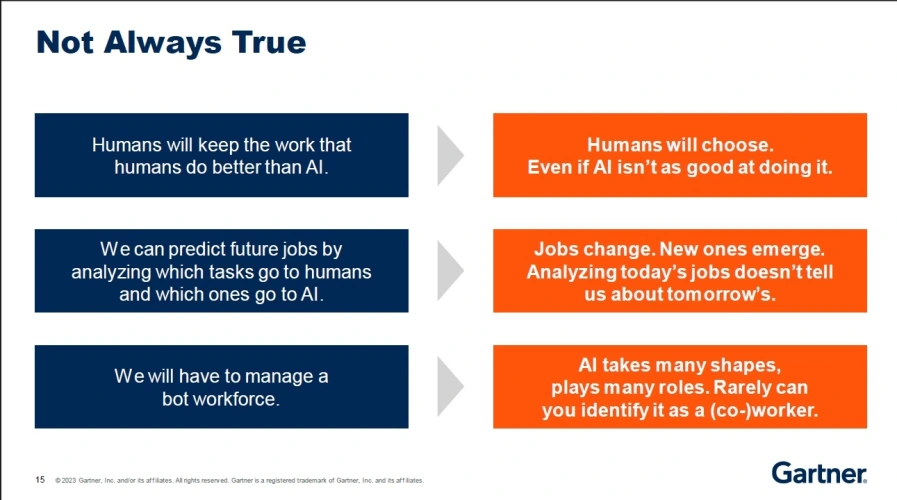

普瓦特温随后花了一些时间揭穿了她所说的关于人工智能和工作的许多神话。

我们认为人类将继续做他们比人工智能做得更好的工作,但情况可能并不总是如此。她引用了一个故事,一个雇主选择了ChatGPT,而不是一个人,尽管这个人做得更好。

她说,关于人类哪些任务做得更好,以及人工智能做得更好的研究没有抓住要点,因为它们忽略了随着工作的变化和演变而发展的新任务和角色。

我们认为我们将不得不管理一支机器人劳动力,但在很大程度上,人工智能和自动化将与人类一起工作,人类将人工智能用作工具。

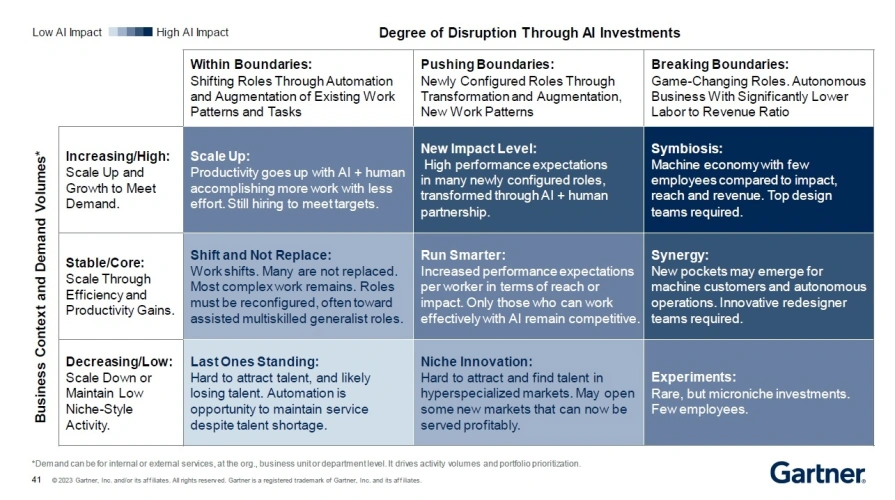

她通过研究人工智能的不同角色和对各种任务的需求,提出了一个人工智能可能如何影响工作的矩阵。

对于角色的种类,她遵循了布赖特诺在会议(上图)中所讨论的“突破界限”和“突破界限”的框架。在第一种情况下,我们看到现有工作模式中的角色转换,这种模式往往会在多年后缓慢演变。在第二种情况下,我们正在创造创造和提供商品和服务的新方式,我们经常需要许多相同的技能,但需要重新设计。在最后一类中,我们有“改变游戏规则”的规则,我们可能会有新的角色和新的机会。

比人工智能能做什么更重要的是我们如何选择使用它,她说。我们可能会选择使用人工智能,即使人类可以做得更好,反之亦然。

然后她谈到了各种劳动力规划项目,解释了所有企业如何管理不同服务的组合以及提供这些服务的人员。人们在投资组合级别上做出这些决定,而不是在任务级别上,因为人们要做多项任务。

Poitevin展示了一些例子,如何挑选一个项目,并根据变化的类型或服务水平将其归类。例如,客户服务代表的人工智能-一个常见的例子-符合范围,是一项稳定或核心的服务,因此可能会看到更多的角色转换;如果员工减少,这将需要数年时间。对于软件开发的生成式AI,它是在边界之内的,但处理不断增长的需求,因此AI帮助您满足需求。但生产率的预期是不切实际的,而且工作倦怠是一个真正的问题,所以你可能仍然想雇佣更多的人。在一个挑战极限的例子中,她谈到了为更多的人提供咨询服务,在这种服务中,人工智能可以降低成本,增加获得有执照的治疗师的机会,但会产生其他影响。

总体而言,她认为,在限制范围内的项目中,工作岗位最有可能被取代,而在挑战或打破边界的申请中,可能会出现新的工作和角色。

普瓦特温说,我们应该努力“让人们减少对工作丢失的恐惧,更多地为他们在建设这些新能力方面所能做出的工作而感到兴奋。”

四种可能的未来

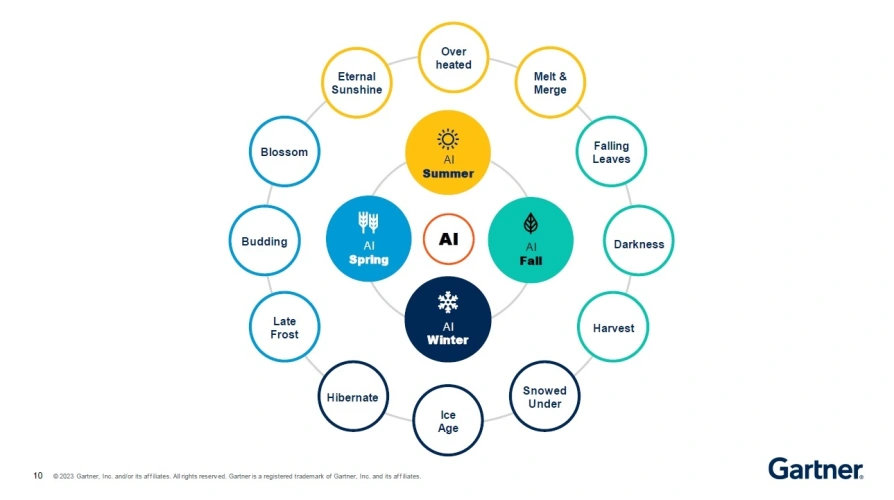

Frank Buytendijk分享了Gartner Future Labs播客对人工智能四种可能未来的看法。

在AI春天,我们将看到组合AI等新范式,它结合了深度学习和知识图谱,而AI所需的计算能力却在下降。在这种情况下,公司应该专注于人工智能创造价值的特定用例,采用负责任的人工智能实践,并管理对人工智能实际使用的现实预期。

在人工智能的夏天,人工智能受益于计算能力的大幅增加,或者我们有人工通用智能或脑机接口之类的东西。在这种情况下,我们可能会让人工智能获得自己的权利法案,而由于机器人的存在,所得税可能会被生产力税取代。在这种情况下,组织需要鼓动一种人工智能优先的文化,但要小心速度过快,有可能绊倒和失去对人工智能的控制。如果发生这种情况,我们不应该低估人工智能作为演员可能对社会产生的潜在冲击效应。

在人工智能的衰落中,将会有大量的工作岗位被取代,人工智能将成为大规模军备竞赛的一部分,隐私保护受到威胁。在这种情况下,人工智能继续创新,但成本仍然很高,为几个超级供应商提供了额外的能力。为了解决这个问题,他建议在组织内提高对人工智能威胁和漏洞的认识,并建立控制措施,以减少对控制的潜在侵蚀。你会想要分散你的赌注,以避免单一供应商锁定人工智能。

最糟糕的情况是人工智能冬天,原因是金融市场崩盘或其他灾难;缺乏足够可靠的数据,导致深度学习暂停;或者对人工智能严重缺乏信任,这是他没有太多谈论的最糟糕情况。在这种情况下,组织应该提高对人工智能的隐藏或负面使用的保护,并保持有关网络安全、错误信息和欺诈的人工智能能力。

有话要说...